[ad_1]

Una de las redes sociales más utilizadas hoy en día es Twitter, donde diariamente millones de usuarios expresan sus opiniones en 280 caracteres. En este escaparate social diverso hay cabida para todo tipo de ideas, aunque muchos aprovechan el anonimato que ofrece la plataforma para desinhibirse y difundir insultos y mensajes de odio.

Como en la vida real, dicha aversión suele dirigirse a los colectivos más desprotegidos. Un ejemplo de ello es la situación que experimentan las mujeres con un puesto de responsabilidad que además tienen perfiles públicos en Twitter, las cuales son acosadas prácticamente a diario. Por ello, muchas de ellas deciden borrar sus perfiles o hacerlos privados, con lo que las voces de estas se acaban silenciando y perdiendo.

La inteligencia artificial nos puede servir de ayuda para analizar las dimensiones reales del problema de los insultos misóginos en Twitter. A través del procesamiento del lenguaje natural, por ejemplo, podemos analizar desde una perspectiva sociolingüística qué palabras son las más repetidas respecto a un tema de discusión, los usuarios que más insultos profieren o incluso extraer el sentimiento que transmite un conjunto de tuits.

El primer paso para el análisis sería crearse una cuenta de desarrollador en Twitter y buscar con la ayuda de una biblioteca del lenguaje de programación Python (como Tweepy) solo aquellos tuits que incluyan palabras pertinentes para la investigación. En nuestro caso podríamos buscar tuits que contengan “feminazi” y se manden en fechas concretas (como el día de la mujer o tras la dimisión de un alto cargo), o nombres de usuario de mujeres bajo el ojo público para analizar la opinión de la mayoría de los usuarios sobre ellas.

Una vez extraídas las muestras, podemos utilizar herramientas de análisis de datos para limpiar los textos y eliminar signos de puntuación o símbolos como “@” o “#”. El objetivo de este proceso es quedarnos con las palabras con más significado, como adjetivos y sustantivos en español. También podríamos ir más allá y realizar una lematización, separando cada palabra según características morfológicas como los sufijos y las raíces para su posterior análisis. También puede resultarnos útil aplicar un corrector ortográfico que “traduzca” la jerga de internet a un lenguaje más estándar.

Seguidamente, aplicamos algoritmos de aprendizaje automático con Python, que contiene bibliotecas de fácil acceso que simplifican notablemente el proceso de análisis. Así, a través de una función podemos distinguir usuarios de género masculino y femenino gracias a sus nombres de usuario y una comparación con una lista extraída del INE, donde aparecen nombres españoles asociados a un género.

Un siguiente paso para analizar los tuits es utilizar programas de inteligencia artificial para extraer conclusiones acerca del sentimiento que estos expresan. Podemos encontrar modelos de análisis de sentimiento en la página web Hugging Face, basados en una tecnología de clasificación de textos desarrollada por Google. Esta hace uso de una arquitectura de red neuronal y etiqueta las palabras según su contexto y su posición en la frase, comparándolo con millones de textos; para determinar si un tuit tiene más contenido que exprese, por ejemplo, alegría, tristeza o enfado.

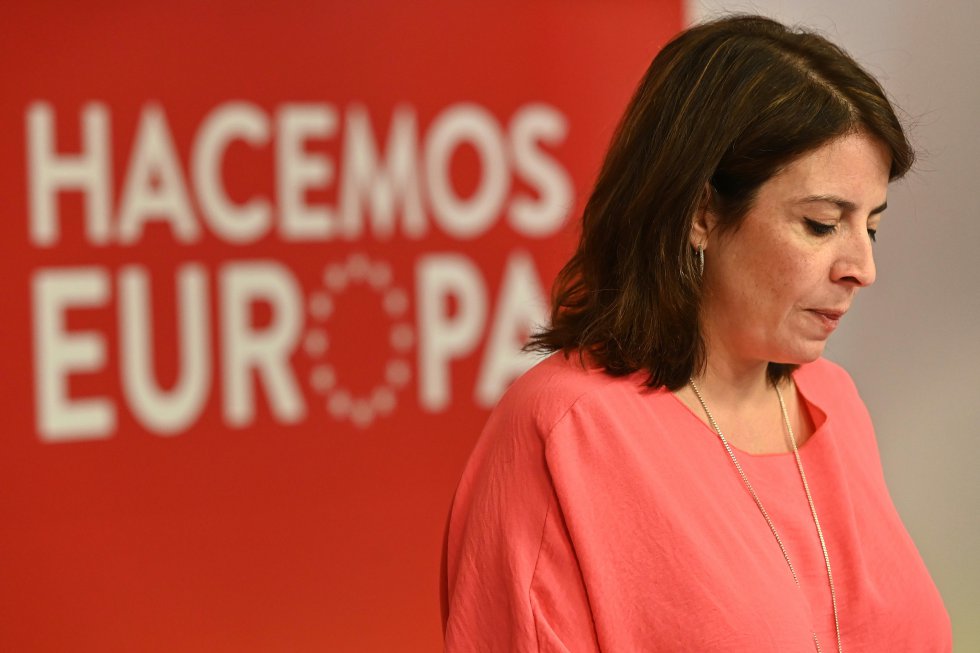

Todas las herramientas citadas resultan útiles para diversos análisis de naturaleza sociolingüística. Precisamente, sirvieron para la realización por parte de la autora del trabajo final del Máster en Letras Digitales titulado Silenciadas en el ciberespacio: una aproximación a la misoginia en línea, donde se analizó la opinión de los usuarios de Twitter acerca de las mujeres Adriana Lastra y Macarena Olona en los respectivos días de su dimisión en 2022. Tras el estudio, se descubrieron tuits graves amenazando la salud de ambas y clasificados mayoritariamente como “enfado” por los modelos de inteligencia artificial. También, a través de un modelo que clasificaba el sentimiento como positivo o negativo, Lastra y Olona recibieron a lo largo de más de 50.000 tuits unas cifras de un 93% y un 63% de comentarios negativos frente a un 7% y un 37% de comentarios positivos, respectivamente. Finalmente, se llegó a la conclusión de que las medidas de prevención contra el acoso misógino de la plataforma son poco efectivas, puesto que comprobamos que comunidades abiertamente misóginas como los llamados incels no son suficientemente sancionados y sus publicaciones seguían (y siguen siendo) legibles en Twitter.

Gran parte de la responsabilidad de acabar con la discriminación recae en las propias instituciones, que deben velar por un internet igualitario. Para ello, las herramientas de inteligencia artificial anteriormente citadas pueden servir tanto a particulares como a empresas para analizar el fenómeno de forma global y contribuir a su extinción, adaptando las medidas a la naturaleza de los insultos y las características de los usuarios que los profieren. En un futuro, quizá sean las propias máquinas quienes actúen de moderadores ante la violencia en línea usando una versión avanzada de estos algoritmos.

Blanca Garrido Salmerón es lingüista computacional y egresada del Máster en Letras Digitales de la Universidad Complutense de Madrid.

Crónicas del Intangible es un espacio de divulgación sobre las ciencias de la computación, coordinado por la sociedad académica SISTEDES (Sociedad de Ingeniería de Software y de Tecnologías de Desarrollo de Software). El intangible es la parte no material de los sistemas informáticos (es decir, el software), y aquí se relatan su historia y su devenir. Los autores son profesores de las universidades españolas, coordinados por Ricardo Peña Marí (catedrático de la Universidad Complutense de Madrid) y Macario Polo Usaola (profesor titular de la Universidad de Castilla-La Mancha).

Puedes seguir a EL PAÍS Tecnología en Facebook y Twitter o apuntarte aquí para recibir nuestra newsletter semanal.

[ad_2]

Source link